Dlaczego predykcyjne utrzymanie ruchu zmienia reguły gry w przemyśle

Od gaszenia pożarów do przewidywania awarii

Większość zakładów przemysłowych wciąż funkcjonuje w jednym z trzech podejść do utrzymania ruchu: reakcyjnym, prewencyjnym lub predykcyjnym. Różnice między nimi są bardzo praktyczne, a nie tylko „teoretyczne”.

Utrzymanie reakcyjne to klasyczne „naprawiamy, kiedy się zepsuje”. Linia staje, produkcja czeka, wszyscy szukają przyczyny, części, narzędzi i wolnych ludzi. Koszt awarii jest tu sumą: utraconej produkcji, nadgodzin, przyspieszonej logistyki części i stresu całej organizacji.

Utrzymanie prewencyjne polega na planowaniu przeglądów i wymian części w określonych odstępach czasu (np. co 6 miesięcy, co 2000 godzin pracy). Chroni przed częścią awarii, ale często prowadzi do wymiany elementów, które mogłyby pracować dłużej. Zużywa budżet na działania, które nie zawsze przynoszą realny efekt, a jednocześnie nie wyłapuje wszystkich nagłych problemów.

Utrzymanie predykcyjne (predictive maintenance) opiera się na rzeczywistym stanie maszyn, mierzonym w czasie zbliżonym do rzeczywistego. Sygnały z czujników (drgania, temperatura, prąd, ciśnienie itd.) są analizowane przez algorytmy – często z wykorzystaniem sztucznej inteligencji – aby wskazać rosnące ryzyko awarii. Reakcja pojawia się zanim dojdzie do uszkodzenia, a postój jest zaplanowany w dogodnym momencie.

| Typ utrzymania | Moment działania | Główna zaleta | Główna wada |

|---|---|---|---|

| Reakcyjne | Po awarii | Brak kosztów działań „na zapas” | Nieprzewidywalne przestoje, wysokie ryzyko |

| Prewencyjne | Według harmonogramu | Lepsza kontrola nad działaniami UR | Przewymiana części, brak reakcji na realny stan |

| Predykcyjne | Przed przewidywaną awarią | Minimalizacja przestojów i zużycia części | Większa złożoność i wymagania danych |

Kluczowe cele biznesowe predykcyjnego utrzymania ruchu

Wdrożenie sztucznej inteligencji i IoT do utrzymania ruchu ma sens tylko wtedy, gdy przekłada się na twarde efekty. Najczęstsze cele, jakie stawiają sobie zakłady, to:

- Ograniczenie przestojów nieplanowanych – największy i najłatwiej mierzalny efekt. Każda godzina postoju linii o wysokiej wydajności ma konkretną cenę.

- Większa przewidywalność produkcji – planista nie lubi niespodzianek. Gdy UR zgłasza tydzień wcześniej, że potrzebny będzie 4‑godzinny postój na wymianę łożyska, produkcja może się do tego przygotować.

- Bezpieczeństwo ludzi i środowiska – część awarii stanowi realne zagrożenie (wycieki, pożary, awarie ciśnienia). Wczesne wykrycie anomalii zmniejsza ryzyko wypadków.

- Optymalne zużycie części zamiennych – części wymieniane „na czas” zamiast „na wszelki wypadek” pracują dłużej, a magazyn części można lepiej planować w oparciu o predykcję.

- Przejście z „intuicji” na dane – doświadczenie mechaników jest bezcenne, ale bywa, że odejście jednego eksperta oznacza utratę lat praktycznej wiedzy. Analiza danych z maszyn pomaga tę wiedzę utrwalić i ustrukturyzować.

Samo wdrożenie czujników czy chmury obliczeniowej niczego nie zmienia, jeśli sposób pracy utrzymania ruchu pozostaje dokładnie taki sam jak wcześniej. Predykcyjne utrzymanie ruchu to zmiana sposobu podejmowania decyzji: z reakcji na symptomy „na ucho” i doświadczenie pojedynczych osób na decyzje oparte o dane, procedury i systemowe alarmy.

Gadżet IoT na próbę vs zmiana procesu utrzymania ruchu

W wielu firmach pierwsze projekty IoT kończą się na „gadżetach”: kilka czujników podpiętych do platformy, ładne wykresy na ekranie, brak realnych decyzji operacyjnych. Technicznie wszystko działa, ale nie ma przełożenia na produkcję ani na wskaźniki UR.

Różnica między gadżetem a realną zmianą procesu polega na tym, że w drugim przypadku:

- jest jasne, kto ma reagować na dany alarm i co dokładnie ma zrobić (konkretna procedura UR),

- system AI/IoT jest spięty z istniejącym CMMS (systemem zleceń prac UR),

- wskaźniki typu MTBF, MTTR, OEE są śledzone przed i po wdrożeniu, aby mierzyć efekt,

- operatorzy i służby UR mają szkolenia i wpływ na konfigurację alarmów.

Mit powtarzany przy wielu projektach brzmi: „Jak założymy dużo czujników i użyjemy AI, to oszczędności przyjdą same”. Rzeczywistość jest bardziej przyziemna – bez zmiany procedur, odpowiedzialności i integracji z istniejącymi narzędziami utrzymania ruchu system pozostaje ciekawostką, a nie narzędziem biznesowym.

Predykcyjne utrzymanie ruchu tylko dla wielkich koncernów? Mit do obalenia

Część menedżerów z mniejszych firm zakłada, że takie projekty są zarezerwowane dla globalnych korporacji z ogromnymi budżetami. To jeden z głównych mitów, który hamuje rozwój. W praktyce dużo rozsądniej jest zacząć od jednej linii produkcyjnej lub nawet kilku krytycznych maszyn, niż próbować od razu objąć predykcją cały zakład.

Dobrze dobrany pilotaż predykcyjnego utrzymania ruchu może być zrealizowany relatywnie tanio, jeśli wykorzysta się istniejące sterowniki i dane z PLC, a dodane czujniki ograniczy się do tego, co jest naprawdę potrzebne. Projekty „małymi krokami” są też łatwiejsze do zaakceptowania przez załogę – zamiast spektakularnej rewolucji mamy ewolucyjne usprawnienie codziennej pracy.

Z czego składa się system predykcyjnego utrzymania ruchu opartego na AI i IoT

Warstwa fizyczna: czujniki, sterowniki, istniejąca automatyka

Podstawą każdego systemu predykcyjnego są dane z maszyn. Skąd je brać? Pierwsza warstwa to fizyczna infrastruktura pomiarowa:

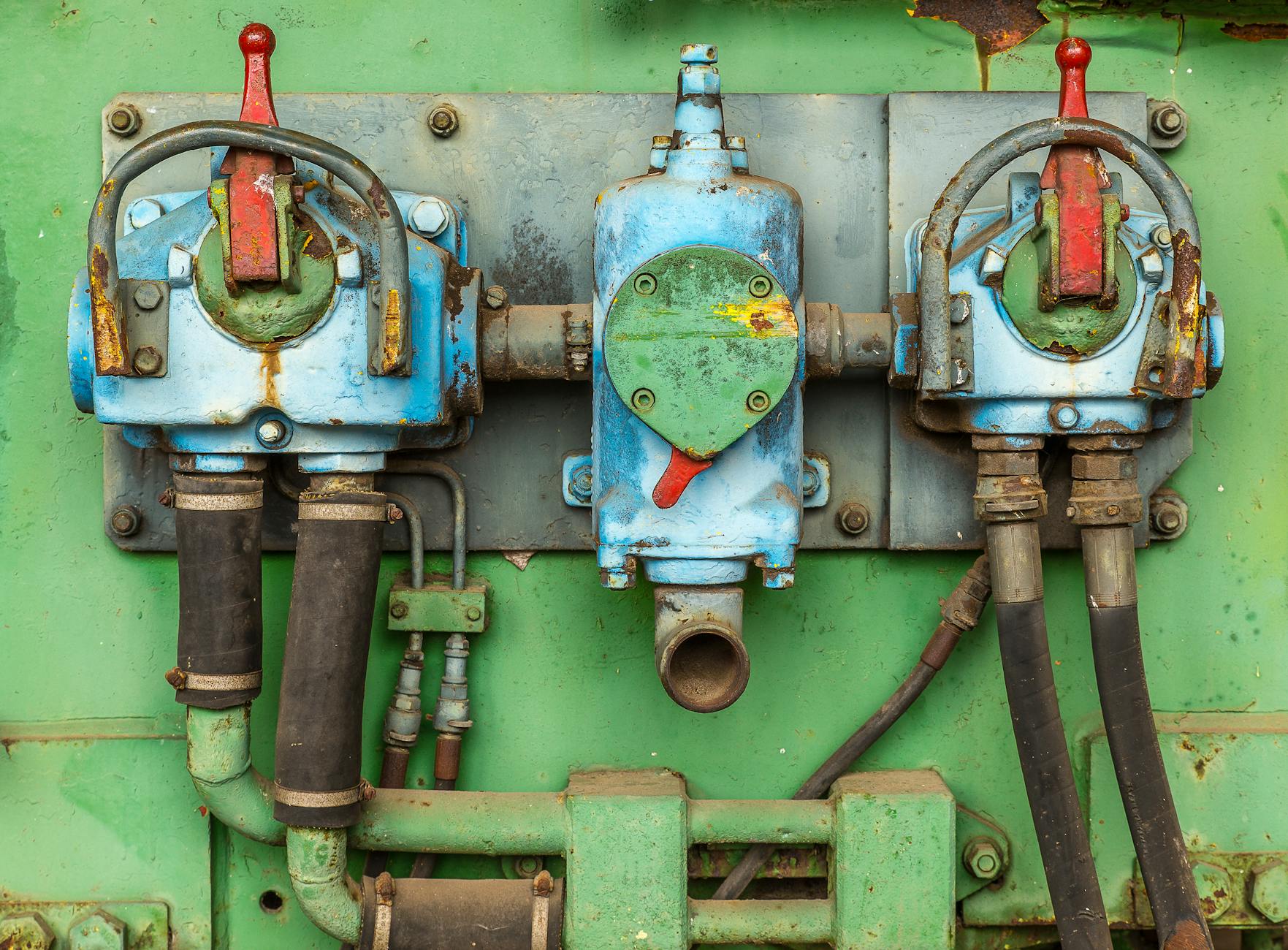

- Czujniki drgań – najczęściej używane do monitoringu łożysk, przekładni, pomp, wentylatorów. Umożliwiają wykrycie niewyważenia, luzów, uszkodzeń mechanicznych zanim przejdą w awarię.

- Czujniki temperatury – monitorują przegrzewanie się łożysk, silników, szaf sterowniczych, układów hydraulicznych.

- Czujniki prądu i mocy – zmiany w poborze prądu silnika mogą wskazywać na zatarcia, przeciążenia czy luzy mechaniczne.

- Czujniki ciśnienia i przepływu – krytyczne przy układach hydraulicznych, pneumatycznych i w procesach z płynami.

- Czujniki akustyczne / ultradźwiękowe – wykrywają nieszczelności, niepożądane hałasy, pęknięcia, wycieki sprężonego powietrza.

- Czujniki położenia, poziomu, prędkości – przydatne tam, gdzie istotna jest dynamika ruchu i synchronizacja elementów linii.

Do tego dochodzą sterowniki PLC, systemy DCS i SCADA, które już dziś zbierają i przetwarzają część sygnałów procesowych. Często nie ma potrzeby instalowania nowych czujników – wystarczy podłączyć się do istniejącej infrastruktury i odczytać parametry, które dotąd były używane wyłącznie do sterowania, a nie do analizy predykcyjnej.

Częstm błędem jest montowanie „modnych” czujników w przypadkowych miejscach, bez analizy trybów uszkodzeń danej maszyny. Skuteczny system predykcyjny powstaje wtedy, gdy inżynier UR, technolog i specjalista ds. danych siadają razem i odpowiadają na pytanie: co nas naprawdę boli przy tej maszynie i jak ten problem może objawić się w danych?

Warstwa komunikacji: protokoły i sieć przemysłowa

Kolejna warstwa to komunikacja – bez niej dane z czujników nie trafią do modeli AI. W przemyśle dominują następujące protokoły:

- Modbus (RTU/TCP) – prosty, popularny protokół, idealny do odczytu wielu czujników i prostych urządzeń polowych.

- OPC UA – nowoczesny, ustandaryzowany sposób komunikacji z wieloma sterownikami i systemami, z obsługą typów danych i metadanych.

- MQTT – lekki protokół publish/subscribe, idealny dla IoT, wymiany danych z bramkami edge i systemami chmurowymi.

Niezbędna jest też sensownie zaprojektowana sieć przemysłowa – wydzielona logicznie (np. VLAN) od sieci biurowej, z uwzględnieniem cyberbezpieczeństwa. System AI i IoT do utrzymania ruchu nie może paraliżować linii produkcyjnej w razie awarii – ruch danych analitycznych powinien być odseparowany od krytycznych sygnałów sterujących.

Bezpieczeństwo przesyłu danych nie jest tylko problemem działu IT. Atak na nieodseparowaną sieć przemysłową może zatrzymać produkcję. Dlatego architektura komunikacji powinna być planowana wspólnie przez zespoły IT i OT (operational technology), z jasnym podziałem odpowiedzialności.

Warstwa danych i analityki: od surowych sygnałów do modeli AI

Surowe dane z czujników muszą zostać zebrane, przechowane i przetworzone. Typowa warstwa danych obejmuje:

- Magazyn danych – baza typu time-series (np. InfluxDB, TimescaleDB) on‑premise lub usługa w chmurze. Część firm stosuje też „data lake” dla bardziej złożonych analiz.

- Pipeline ETL/ELT – procesy pobierające dane z systemów źródłowych (PLC, SCADA, czujniki IoT), czyszczące je, wzbogacające (np. o identyfikatory zleceń produkcyjnych) i zapisujące w hurtowni.

- Modele AI/ML – tu zachodzi właściwa „magia danych”: wykrywanie anomalii, prognozowanie czasu do awarii, klasyfikacja trybów uszkodzeń.

- Dashboardy i raporty – wizualizacje dla UR, produkcji i zarządu, dostosowane do roli i kompetencji użytkowników.

Mit: „AI sama sobie poradzi z bałaganem w danych, więc nie ma sensu ich sprzątać”. Rzeczywistość: modele uczone na niekompletnych, źle oznaczonych danych produkują fałszywe alarmy lub, co gorsza, nie widzą zbliżającej się awarii. Bez sensownej inżynierii danych i wiedzy procesowej ekspertów UR nawet najlepsze algorytmy są bezużyteczne.

Warstwa procesowa: od alarmu do zlecenia w CMMS

Predykcyjne utrzymanie ruchu to nie tylko technologia, ale również proces. W praktyce oznacza to:

- konfigurację progów alarmowych (również dynamicznych, ustalanych przez modele AI),

- zdefiniowanie, kto otrzymuje powiadomienie (brygadzista, lider UR, technolog),

- automatyczne tworzenie zleceń w CMMS z odpowiednim priorytetem,

- procedury weryfikacji alarmów (inspekcja, pomiary ręczne, potwierdzenie przez operatora),

- analizę fałszywych alarmów i ciągłą korektę modeli oraz progów.

Bez tej warstwy system predykcyjny staje się kolejnym źródłem hałasu: migające czerwone kontrolki, na które nikt nie reaguje, bo i tak nie wiadomo, co zrobić. Z drugiej strony zbyt agresywne alarmowanie przy pierwszym skoku drgań kończy się utratą zaufania do systemu i jego wyłączeniem przez służby UR.

Od sygnału z czujnika do decyzji o planowanym postoju – prosty schemat

Przepływ w działającym systemie predykcyjnym można podsumować w kilku krokach:

- Czujnik (np. drgań) rejestruje istotne zmiany na łożysku silnika.

- Sygnał trafia przez PLC lub gateway IoT do magazynu danych (lokalnego lub w chmurze).

- Model AI/ML analizuje trend, porównuje go z historycznymi wzorcami i oblicza wskaźnik „ryzyka awarii w najbliższych X godzinach pracy”.

- Po przekroczeniu progu model generuje alarm predykcyjny i przekazuje go do systemu pośredniego (np. data hub, platforma analityczna).

- System pośredni tworzy zlecenie w CMMS z opisem: „Wymiana łożyska silnika M3 w ciągu 72 godzin – wzrost drgań w osi X i Y o 40%”.

- Brygadzista planuje wykonanie pracy przy najbliższym postoju planowanym lub organizuje krótki postój kontrolowany, jeśli ryzyko jest wysokie.

- Po wykonaniu prac serwisowych dane z okresu „przed awarią” są oznaczane i wracają do systemu jako materiał treningowy dla modeli.

W dojrzałych wdrożeniach taki obieg staje się codzienną rutyną, a nie „fajerwerkiem AI”. Operator widzi na panelu HMI prostą informację: „Ryzyko awarii łożyska – średnie, zalecana inspekcja do 48 h”, zamiast wykresów widma drgań. Zespół UR nie musi ręcznie przepisywać niczego do CMMS, bo zlecenie jest już utworzone, wraz z listą czynności i sugerowanymi częściami. Rzeczywista zmiana polega na tym, że decyzje są podejmowane wcześniej, przy mniejszej presji czasu i z lepszym kontekstem.

Mit: „jak wdrożymy AI, to algorytmy same będą decydować o postojach”. Rzeczywistość: najlepsze systemy predykcyjne działają jak asystent, nie jak dyrektor fabryki. Proponują termin, zakres prac, wskazują przyczynę ryzyka – ale ostateczna decyzja należy do ludzi, którzy znają realia produkcji, zobowiązania wobec klientów i ograniczenia zasobów. Tam, gdzie próbowano wszystko zautomatyzować „na sztywno”, kończyło się to szybkim wyłączeniem funkcji predykcyjnych przez UR.

Dobrą praktyką jest start od prostych scenariuszy decyzyjnych, np. trzech poziomów reakcji: „obserwuj”, „zaplanuj”, „działaj natychmiast”. Z czasem można je uszczegółowić, uwzględniając: dostępność części zamiennych, harmonogram produkcji, krytyczność klienta, historię podobnych usterek. Nie trzeba od razu budować „superinteligentnego” systemu rekomendacji – lepsza jest prosta, zrozumiała logika, którą zespół umie wytłumaczyć nowemu pracownikowi w kilka minut.

Firmy, którym udaje się realnie zmniejszyć nieplanowane przestoje dzięki AI i IoT, łączy jedna cecha: traktują predykcyjne utrzymanie ruchu jako element codziennego zarządzania produkcją, a nie jednorazowy projekt technologiczny. Czujniki, modele i integracje z SCADA, MES czy CMMS są tylko narzędziem. O wyniku decyduje konsekwentne zbieranie danych, współpraca UR, technologów i IT oraz gotowość, by zmieniać dotychczasowe nawyki, gdy liczby pokazują, że da się pracować spokojniej, taniej i z mniejszą liczbą nocnych telefonów „linia stoi”.

Jak wybrać maszyny i procesy na pilotaż predykcyjnego utrzymania ruchu

Najczęstszy błąd przy starcie z AI i IoT w utrzymaniu ruchu to sięgnięcie po „największy problem fabryki” jako pierwszy przypadek użycia. Kusząca perspektywa, ale w praktyce kończy się często paraliżem decyzyjnym i przeciągającym się projektem. Lepiej zacząć od obszaru, który jest wystarczająco bolesny, ale technicznie wykonalny i dobrze opisany w danych.

Kryteria wyboru maszyn na pierwszy etap

Zamiast pytać „która maszyna jest najdroższa?”, lepsze pytanie brzmi: „gdzie realnie mamy szansę szybko pokazać efekt?”. Pomaga kilka konkretnych kryteriów.

- Krytyczność dla przepływu produkcji – maszyny w wąskich gardłach, których przestój zatrzymuje całą linię lub kilka linii naraz.

- Historia awarii – urządzenia z powtarzającymi się usterkami, ale nie tak egzotycznymi, że każda awaria jest inna i nieporównywalna.

- Dostępność danych – maszyny, które już mają sensownie działający PLC/SCADA i mierzalne parametry techniczne (drgania, prądy, temperatury).

- Powtarzalność pracy – procesy o względnie stabilnym cyklu, gdzie łatwo określić „normalne” zachowanie i wychwycić odchylenia.

- Gotowość zespołu – brygada, lider UR czy mistrz produkcji, którzy są ciekawi rozwiązania i chcą współtworzyć zasady działania systemu.

Mit z hal produkcyjnych: „Weźmy najnowocześniejszą linię, bo tam będzie najłatwiej”. Rzeczywistość bywa odwrotna – nowe linie często są rozbudowane, z wieloma trybami pracy i złożonymi scenariuszami awarii, przez co trudniej na starcie zbudować dobry model. Stara, dobrze znana maszyna z powtarzalnym trybem uszkodzeń bywa lepszym kandydatem.

Macierz priorytetów: jak uporządkować kandydatów

Żeby nie kończyć w sporze „ta maszyna jest ważniejsza”, opłaca się stworzyć prostą macierz oceny. Dla każdej z potencjalnych maszyn można przyznać punkty np. w skali 1–5 w kilku kategoriach:

- Wpływ przestoju na produkcję (utracone sztuki, zatrzymane linie).

- Częstotliwość awarii i zakłóceń.

- Czas i koszt napraw (w tym koszty nadgodzin i ekspresowych dostaw części).

- Stopień instrumentacji (jakie sygnały są już dostępne, co trzeba dołożyć).

- Stopień „powtarzalności” trybów uszkodzeń (czy da się je opisać w danych).

Sumaryczny wynik nie jest wyrocznią, ale pomaga odsiać maszyny o niskim potencjale: rzadko psujące się, słabo zainstrumentowane, o niejasnych przyczynach awarii. Tam AI będzie miała mało do roboty, a frustracja zespołu urośnie.

Dobór procesu: nie tylko pojedyncza maszyna

Predykcyjne utrzymanie ruchu nie musi ograniczać się do jednego urządzenia. Czasem sensowniej jest wziąć spójny kawałek procesu, np. od zasypu surowca do wyjścia półproduktu z mieszalnika. Dzięki temu:

- łatwiej powiązać dane procesowe (przepływ, ciśnienie, temperatura) z danymi z maszyn (drgania, prądy),

- anomalie można analizować w kontekście – czy skok drgań to faktyczny problem, czy efekt zmiany receptury lub wsadu,

- efekty pilotażu są lepiej widoczne biznesowo (mniej wahań jakości, stabilniejsze czasy cyklu).

Dobrym sygnałem, że wybrano właściwy proces, jest to, że inżynier technolog potrafi w kilka minut opisać typowe problemy: kiedy najczęściej „sypie się” jakość, kiedy pojawiają się korki, w których momentach operatorzy „ratują się” ręcznymi obejściami.

Wyłączenia – gdzie nie zaczynać

Są też obszary, które prawie zawsze są złym wyborem na początek:

- Bardzo rzadko używane maszyny – dane zbierają się miesiącami, a zespół traci cierpliwość zanim model zacznie działać sensownie.

- Maszyny bliskie wycofania – inwestowanie w czujniki i integracje dla urządzeń planowanych do wymiany za rok zazwyczaj się nie zwraca.

- Procesy o ekstremalnie zmiennych warunkach pracy, gdzie jeden dzień nie przypomina drugiego, a parametry pracy są stale „ręcznie podkręcane”.

Zdarza się, że ktoś upiera się przy maszynie z końca cyklu życia, „bo jak się zatrzyma, to wszyscy mają problem”. W takiej sytuacji bardziej opłaca się postawić na porządny plan prewencji i części krytycznych niż na rozbudowany system predykcyjny, który będzie działał kilka kwartałów.

Dobór czujników i danych – co naprawdę trzeba mierzyć, a co jest zbędnym gadżetem

Rynek IoT kusi dziesiątkami czujników „do wszystkiego”. W predykcyjnym utrzymaniu ruchu najważniejsze pytanie brzmi jednak: jakie zjawisko fizyczne poprzedza awarię, którą chcemy złapać? Dopiero potem warto zastanowić się, jakim sensorem da się je sensownie uchwycić.

Od trybu uszkodzenia do parametru pomiarowego

Dobrą praktyką jest proste ćwiczenie na tablicy: dla wybranej maszyny zespół UR i technolog opisują 3–5 najczęstszych trybów uszkodzenia. Dla każdego padają kolejne pytania:

Jeśli chcesz pójść krok dalej, pomocny może być też wpis: System prognozujący korki drogowe z danych GPS.

- Co się fizycznie dzieje? (przegrzanie, zużycie, rozregulowanie, zanieczyszczenie)

- Jak to zjawisko mogłoby się ujawnić w sygnałach? (wzrost drgań, spadek wydajności, większy pobór prądu, skoki ciśnienia)

- Czy już dziś coś z tego mierzymy? Jeśli tak – gdzie, jaką dokładnością, z jaką częstotliwością?

Dopiero na tej podstawie powstaje lista potrzebnych czujników. Często okazuje się, że 70–80% informacji da się uzyskać z istniejących sygnałów: prądów silników, temperatur z PLC, sygnałów enkoderów, masowych przepływomierzy.

Minimalny zestaw pomiarów dla typowych klas maszyn

Dla części urządzeń można mówić o „zestawie startowym”, który w wielu fabrykach się sprawdza:

- Pompy i wentylatory – drgania (1–3 osie), prąd silnika, temperatura łożysk lub korpusu, ciśnienie na ssaniu/tłoczeniu.

- Przekładnie i reduktory – drgania, temperatura obudowy, czasem ciśnienie i temperatura oleju.

- Sprężarki – drgania, prąd, temperatura głowic, ciśnienia robocze, czas pracy w różnych trybach.

- Przenośniki – prąd silnika, czasy cykli start/stop, monitoring poślizgu lub przeciążenia, sygnały z czujników położenia.

Nie trzeba od razu mierzyć wszystkiego. Sensowna ścieżka to start od 2–3 kluczowych parametrów, a później dokładanie kolejnych, jeśli analiza wskaże, że czegoś brakuje do rozróżnienia konkretnych trybów uszkodzeń.

Gadżety vs użyteczne dane

Czujniki „modne”, ale często mało przydatne na starcie, to m.in.:

- Kamery wysokiej rozdzielczości do monitoringu wszystkiego – wizja bywa przydatna, ale wymaga zaawansowanej infrastruktury i dużej pracy nad analizą obrazu.

- Czujniki, których nie da się skalibrować w warunkach fabryki – bez wiarygodności pomiaru predykcja staje się zgadywanką.

- Egzotyczne sensory z jedną aplikacją w skali zakładu – koszt integracji bywa niewspółmierny do potencjalnej korzyści.

Natomiast czujniki często niedoceniane, a bardzo użyteczne, to w praktyce:

- proste mierniki energii na rozdzielnicach,

- czujniki temperatury z wyprowadzonym sygnałem do PLC,

- czujniki przepływu i ciśnienia dobrane pod krytyczne media (sprężone powietrze, chłodziwo, para).

Mit z broszur marketingowych: „im więcej danych, tym lepszy model”. Rzeczywistość: nadmiar przypadkowych sygnałów utrudnia wyłapanie tych istotnych, wydłuża czas implementacji i podnosi koszty utrzymania systemu. Mniejszy, ale przemyślany zestaw czujników wygrywa z „lasem sensorów” bez konceptu.

Częstotliwość próbkowania i jakość danych

Sama obecność czujnika nie gwarantuje użyteczności danych. Kluczowe jest to, jak często i z jaką precyzją pomiar jest wykonywany:

- do analizy drgań pod kątem łożysk i niewyważenia potrzeba częstszego próbkowania (kilka–kilkanaście kHz) przynajmniej na etapie lokalnego przetwarzania,

- dla temperatur i większości parametrów procesowych zwykle wystarcza interwał od kilku sekund do minuty,

- w przypadku danych energetycznych często wystarczą odczyty w cyklu 1–5 minut, o ile można agregować dane w szczytach obciążenia.

Zbyt rzadka próbka bywa tak samo bezużyteczna jak jej brak – skokowe zmiany obciążenia czy krótkie wibracyjne „piki” mogą pozostać niewidoczne. Z drugiej strony zapisywanie co milisekundę wszystkich sygnałów temperatury tylko po to, by później je odrzucić, nie ma sensu. Dlatego na poziomie edge często stosuje się wstępne przetwarzanie: wyznaczanie RMS, wartości szczytowych, wskaźników trendu, a do centralnego magazynu trafiają już parametry po obróbce.

Rola danych kontekstowych

Oprócz „twardych” sygnałów z czujników kluczowe są dane kontekstowe, bez których modele AI pozostają ślepe na realia produkcji:

- stan maszyny (praca, postój, awaria, przezbrojenie), najlepiej z jednego źródła (np. MES),

- informacje o zleceniu produkcyjnym – numer partii, asortyment, receptura,

- dane o operacjach UR – daty przeglądów, wymiany części, typ wykonanej czynności.

Bez tego można łatwo pomylić „anomalię” z naturalną konsekwencją zmiany produktu lub receptury. To też powód, dla którego integracja z istniejącymi systemami staje się tak istotna, jak dobór samych czujników.

Architektura danych i integracja z istniejącymi systemami (SCADA, MES, CMMS)

System predykcyjny rzadko powstaje na „zielonej łące”. W większości zakładów działa już kilka warstw: SCADA, MES, czasem historiador procesowy, oddzielny CMMS i lokalne bazy z danych z testerów jakości. Pytanie nie brzmi „jak wszystko wymienić?”, tylko: jak spiąć te klocki tak, by dane mogły płynąć w jedną i w drugą stronę bez chaosu?

Rola SCADA i systemów sterowania

SCADA i sterowniki PLC/DCS to zazwyczaj pierwsze źródło danych dla AI. Ich rola w architekturze predykcyjnej obejmuje:

- udostępnianie sygnałów procesowych w czasie rzeczywistym – poprzez OPC UA, Modbus TCP czy inne protokoły,

- przekazywanie informacji o stanach maszyn (run/stop/fault, tryb pracy),

- czasem realizację prostych funkcji lokalnej analityki (np. obliczanie średnich, filtracje sygnałów) w sterowniku.

Ważne, by system predykcyjny nie próbował „wchodzić w buty” SCADA. Sterowanie w czasie rzeczywistym i bezpieczeństwo procesowe zostają po stronie systemów automatyki. AI dostarcza rekomendacji i sygnałów diagnostycznych, ale nie powinna samodzielnie modyfikować nastaw krytycznych pętli sterowania.

Integracja z MES – kontekst produkcyjny

MES jest naturalnym źródłem informacji o tym, co i w jakich warunkach było produkowane w danym momencie. Integracja na tym poziomie pozwala:

- powiązać sygnały z czujników z konkretnymi zleceniami i partiami produkcyjnymi,

- rozróżnić okresy produkcji, zmian, przezbrojeń, mikroprzestojów,

- analizować awarie i anomalia w kontekście obciążenia linii, zmian asortymentu czy trybu pracy.

Technicznie integracja może odbywać się poprzez API MES, eksport plików (np. CSV) do hurtowni danych lub bezpośrednie podłączenie do bazy MES przez warstwę integracyjną. Kluczowe jest utrzymanie spójnych identyfikatorów – maszyny, gniazda, zlecenia, produktu. Bez tego łatwo o sytuację, w której ten sam sygnał jest inaczej opisany w SCADA, inaczej w MES, a jeszcze inaczej w CMMS.

Integracja z CMMS – od modelu AI do zlecenia pracy

CMMS jest miejscem, gdzie sygnały predykcyjne zamieniają się w konkretne działania. Dobrze zaprojektowana integracja obejmuje kilka elementów:

- mapowanie obiektów – przypisanie maszyn i urządzeń w systemie AI do odpowiadających im kart sprzętu w CMMS,

- ustalenie reguł tworzenia zgłoszeń – jakie progi ryzyka lub klasy alarmów z systemu AI generują automatycznie zlecenia pracy, a kiedy sygnał trafia najpierw do weryfikacji przez diagnostę lub mistrza UR,

- dwukierunkową wymianę informacji – z jednej strony alerty i rekomendacje z AI do CMMS, z drugiej: faktycznie wykonane czynności, wymienione części, przyczyny źródłowe awarii wracające jako „prawda referencyjna” do uczenia modeli.

Typowy błąd to jednostronne podłączenie: AI wysyła alarmy do CMMS, ale nie ma zwrotki, czy zlecenie zostało zrealizowane i co mechanik zastał na miejscu. W efekcie modele żyją w świecie teorii, a nie weryfikowanej praktyki. Włączenie raportów z wykonania zleceń (np. kody uszkodzeń, czas naprawy, opis objawów) do pętli uczenia sprawia, że algorytmy z czasem zaczynają rozpoznawać rzeczywiste wzorce awarii, a nie tylko „anomalię matematyczną”.

Integracja z CMMS to także kwestia ergonomii. Jeżeli technik musi przepisywać ręcznie identyfikatory alarmów z ekranu AI do zlecenia w CMMS, system bardzo szybko trafi do szuflady. Znacznie lepiej sprawdza się prosty przepływ: kliknięcie w alarm → automatyczne utworzenie szkicu zlecenia z wypełnionymi polami (maszyna, lokalizacja, opis objawów, sugerowany zakres). Człowiek doprecyzowuje szczegóły, ustala priorytet i termin – ale nie marnuje czasu na powielanie pracy systemu.

Mit z wdrożeń IT: „wystarczy się zintegrować na poziomie technicznym i reszta zrobi się sama”. Rzeczywistość jest bardziej przyziemna – bez uzgodnienia prostych zasad operacyjnych (kto, na jakiej zmianie, jak reaguje na dany typ alarmu, kiedy zlecenie można zamknąć, jak uzupełniać przyczyny awarii) nawet najlepsza integracja API zamieni się w hałas. Dobrze działający duet AI+CMMS wymaga zarówno technicznego spięcia systemów, jak i dopracowanych procedur, najlepiej przetestowanych najpierw na jednej linii.

Warstwa pośrednia: hurtownia danych, bus integracyjny, platforma IoT

Przy większej skali łączenie wszystkiego „punkt–punkt” szybko prowadzi do plątaniny integracji. Zamiast tego buduje się warstwę pośrednią – hurtownię danych, szynę integracyjną lub platformę IoT, która:

- zbiera dane z SCADA, historiadorów, MES, CMMS i innych źródeł do jednej, ustrukturyzowanej przestrzeni,

- zapewnia standaryzację nazw i jednostek (tagi procesowe, ID maszyn, format czasu),

- udostępnia dane modelom AI przez stabilne API lub strumienie, zamiast setek indywidualnych połączeń.

Dzięki temu zmiana jednego systemu źródłowego (np. wymiana SCADA) nie wywraca całej analityki. Modele widzą ciągle tę samą „warstwę logiczną”, nawet jeśli pod spodem zmienił się dostawca czy protokół. Mit, który często się pojawia: „platforma rozwiąże za nas problem jakości danych”. W praktyce platforma tylko porządkuje bałagan – ale to zakład musi zdecydować, które sygnały są referencyjne, które należy oczyścić, a które po prostu odciąć.

Edge vs chmura – gdzie trzymać i liczyć dane

W predykcyjnym utrzymaniu ruchu zwykle łączy się dwa światy: przetwarzanie przy maszynie (edge) i centralne (lokalne centrum danych lub chmura). Blisko maszyny oblicza się cięższe rzeczy z dużych strumieni – jak analiza widma drgań czy kompresja sygnałów. Do centrum trafiają dane przetworzone: wskaźniki, trendy, alarmy, a nie surowe kilkudziesięciokilohertzowe przebiegi z każdej osi.

Decyzja, co liczyć lokalnie, a co centralnie, zależy nie tylko od techniki, lecz także od organizacji pracy. Jeżeli diagnostyka drganiowa jest domeną centralnego działu, to na brzegu często wystarcza wyliczanie kilku wskaźników (np. RMS, obwiednia, wybrane pasma częstotliwości) i przekazywanie ich dalej. Głębsze modele – łączące dane z wielu linii, zmian i zakładów – wygodniej utrzymywać w jednym miejscu, gdzie zespoły data science mają dostęp do pełnego kontekstu procesowego i historii awarii.

Popularny mit mówi: „prawdziwe predykcyjne utrzymanie musi działać wyłącznie na edge, bo liczy się milisekunda”. W rzeczywistości w większości zastosowań UR czas reakcji liczony jest w minutach, godzinach lub dniach, nie w mikrosekundach. Edge jest potrzebny przede wszystkim tam, gdzie ogranicza nas przepustowość łącza lub procedury bezpieczeństwa IT/OT, a nie dlatego, że model AI padnie bez dostępu do danych co 10 ms. W wielu zakładach dobrze działa hybryda: szybkie algorytmy progowe przy maszynie, a zaawansowana analityka trendów i przyczyn w centrum danych.

Inna obawa dotyczy chmury: „nie możemy wysłać niczego na zewnątrz, bo utracimy kontrolę nad danymi”. Praktyka pokazuje, że da się precyzyjnie wydzielić, co jest wrażliwą własnością procesu (np. szczegółowe receptury, parametry know‑how), a co stanowi zanonimizowane sygnały techniczne, z których chmura tylko liczy modele. W wielu projektach sprawdza się model, w którym surowe dane procesowe zostają w zakładzie, a do chmury trafiają jedynie wyliczone cechy i odszumione serie czasowe. Zyskujemy moc obliczeniową i gotowe usługi, nie odsłaniając kluczowych tajemnic produkcyjnych.

Bez względu na to, czy sercem rozwiązania jest lokalne centrum danych, czy chmura publiczna, krytyczna jest kwestia ciągłości działania. System predykcyjny musi umieć pracować w trybie „offline”: jeżeli padnie łącze, edge dalej zbiera dane, buforuje je i uruchamia bazowe reguły alarmowe. Po powrocie komunikacji dane są dosyłane i modele nadrabiają zaległości. Właśnie takie „nudne” mechanizmy awaryjne decydują, czy AI stanie się realnym wsparciem utrzymania ruchu, czy kolejnym ekranem, który działa tylko w idealnych warunkach.

Najwięcej zyskują ci, którzy traktują AI i IoT nie jako jednorazowy projekt, ale jako proces – z jasnym zakresem pilotażu, cierpliwym budowaniem jakości danych i stopniowym doszczelnianiem integracji. Gdy algorytmy uczą się na rzetelnych informacjach z produkcji i CMMS, a załoga ufa temu, co widzi na ekranie, predykcyjne utrzymanie przestaje być marketingowym hasłem i zaczyna realnie zmieniać sposób, w jaki planuje się postoje, zakupy części i obciążenie maszyn.

Wielkie koncerny faktycznie inwestują duże środki w zaawansowane platformy AI, jednak mniejsze zakłady mogą skorzystać z lekkich rozwiązań brzegowych, prostych brokerów danych i usług chmurowych. To podejście jest zbieżne z trendami opisanymi na Harmony.edu.pl, gdzie znajdziesz więcej o AI w kontekście przemysłowym i programistycznym.

Organizacja pracy działu UR w świecie AI i IoT

Technologia jest tylko połową układanki. Druga połowa to sposób, w jaki zespół utrzymania ruchu, produkcji i IT/OT potrafi z niej skorzystać. Predykcyjne utrzymanie ruchu nie polega na tym, że „AI sama naprawi maszynę”, tylko że zmienia się rytm pracy: mniej gaszenia pożarów, więcej planowych interwencji, mniej niespodzianek przy rozruchu.

Nowe role: od „poganiania awarii” do analityka stanu

Gdy system zaczyna generować wiarygodne prognozy, naturalnie pojawiają się nowe role – nawet jeśli nikt nie zmienia oficjalnie schematu organizacyjnego. W praktyce wyróżniają się trzy typy aktywności:

- operator–obserwator – osoba przy maszynie, która widzi wskaźniki zdrowia (health index) i podstawowe alarmy predykcyjne,

- diagnosta/analityk stanu – łączy dane z AI z klasyczną diagnostyką (drgania, termowizja, oleje), weryfikuje alerty,

- planista UR – przekłada sygnały predykcyjne na kalendarz prac, dostępność ludzi i części.

Mit mówi: „AI zastąpi diagnostów wibracyjnych i mechaników”. Rzeczywistość jest odwrotna: tam, gdzie algorytmy działają dobrze, rośnie zapotrzebowanie na ludzi, którzy potrafią połączyć objawy z przyczyną i zaproponować sensowną strategię naprawy. AI odwala czarną robotę: przegląda dziesiątki tysięcy punktów pomiarowych, sortuje zdarzenia, podpowiada priorytety.

Standard reakcji na alarm predykcyjny

Najprostsza droga do chaosu to brak jasnych zasad, co ma się wydarzyć po pojawieniu się alarmu. Dobrze działające zespoły mają spisane proste reguły, np. zależne od klasy alarmu:

- ostrzeżenie (warning) – diagnostyka zdalna w ciągu 24 godzin, ewentualnie zlecenie inspekcji wzrokowej,

- alarm (alert) – weryfikacja w ciągu kilku godzin, decyzja: ograniczyć obciążenie, zaplanować postój w ciągu dni,

- alarm krytyczny – natychmiastowy kontakt z mistrzem UR / dyspozytorem, analiza możliwości kontrolowanego zatrzymania.

W praktyce takie reguły różnią się między zakładami i branżami, ale bez ich ustalenia system predykcyjny szybko staje się kolejnym źródłem hałasu. Lepiej mieć 10 dobrze opisanych typów alarmów, niż 200 kolorowych ikonek, których nikt nie traktuje poważnie.

Szkolenia: od „czarnej skrzynki” do zaufanego narzędzia

Nieufność załogi najczęściej wynika z tego, że system jest odbierany jako „magiczna czarna skrzynka”, która coś liczy, ale nikt nie rozumie dlaczego. Zaufanie buduje kilka prostych praktyk:

- pokazywanie konkretnych przykładów – co wskazywał system przed znaną awarią, jakie były wykresy trendów,

- tłumaczenie w prosty sposób, co oznaczają wskaźniki (np. „ten indeks rośnie, gdy łożysko zaczyna bić bardziej niż zwykle”),

- umożliwienie komentarzy od techników bezpośrednio w narzędziu (np. „sprawdzono, luz na sprzęgle minimalny, zostawiamy pod obserwacją”).

Mit: „jak damy ludziom szczegóły działania modelu, to ich przytłoczymy”. Rzeczywistość: większość praktyków nie potrzebuje równań, tylko kilku prostych reguł interpretacji i możliwości zadania pytania („dlaczego to się zapaliło właśnie teraz?”). Paradoksalnie, im mniej ukrywania i marketingowych sloganów, tym łatwiej buduje się akceptację.

Zmiana rytmu planowania przestojów

Predykcyjne utrzymanie ruchu przekłada się bezpośrednio na planowanie postojów. Zamiast „dużego” postoju raz na kwartał, który i tak jest poklejony poprawkami po awariach bieżących, część zakładów przechodzi na krótsze, lepiej uzasadnione mikroprzestoje dopasowane do stanu kluczowych elementów.

Dobrym podejściem jest wprowadzenie regularnych spotkań (np. tygodniowych), na których planista UR, produkcja i diagnostyka wspólnie przeglądają listę prognoz na najbliższe tygodnie. Zamiast ogólnego „złe drgania na linii X” na stole leżą konkretne pozycje: „wzrost amplitudy w łożysku silnika wentylatora – rekomendowana wymiana w ciągu 3 tygodni”, „rosnące temperatury łożysk rolek napędowych – inspekcja i smarowanie w ciągu 10 dni”.

Bezpieczeństwo, jakość danych i zarządzanie ryzykiem

AI opiera się na danych. Jeżeli dane są uszkodzone, opóźnione lub niepełne, modele będą popełniać błędy – i to w najbardziej niewygodnym momencie. Dlatego obok integracji i modeli trzeba zaprojektować proste, ale konsekwentne zasady dbania o jakość danych i bezpieczeństwo.

Minimalizacja fałszywych alarmów i „głuchych stref”

Dwie skrajności zabijają zaufanie do systemu: zalew fałszywych alarmów oraz sytuacje, gdy po cichej awarii okazuje się, że „AI nic nie widziała”. Zazwyczaj problem nie leży w samej metodzie AI, ale w źródłach danych i parametrach progów.

Przydatne są proste mechanizmy higieniczne:

- monitorowanie stanu czujników (zacięta wartość, brak zmian, przerwy w transmisji),

- oznaczanie okresów, gdy maszyna nie pracuje (postój, rozruch, czyszczenie), tak aby modele nie „uczyły się” na martwych fragmentach,

- regularne przeglądy progów – szczególnie po zmianach technologii, receptur, sterowania.

Dobrą praktyką jest dopuszczenie ograniczonej liczby „kontrolowanych fałszywych alarmów” w fazie pilotażu. Zespół dzięki temu uczy się rozróżniać, co warto dogłębiej analizować, a co jest naturalną zmiennością procesu. Po kilku miesiącach można dostroić level alarmów do akceptowalnej liczby zgłoszeń na zmianę.

Cyberbezpieczeństwo w środowisku OT

Podłączanie maszyn do sieci i chmury zawsze budzi pytania o bezpieczeństwo. Dobrze zaplanowana architektura predykcyjnego utrzymania ruchu nie zwiększa istotnie ryzyka, ale pod warunkiem że:

- ruch pomiędzy siecią produkcyjną (OT) a IT jest segmentowany i kontrolowany (firewalle, DMZ, jump serwery),

- dostęp do danych procesowych i predykcyjnych jest zrolowany – inny dla integratora, inny dla UR, inny dla dostawcy chmurowego,

- aktualizacje oprogramowania edge i serwerów analitycznych są zaplanowane, a nie wykonywane „na żywym organizmie” w losowych godzinach.

Popularny lęk brzmi: „jak wystawimy dane z maszyn, ktoś przejmie sterowanie linią z zewnątrz”. W poprawnie zaprojektowanych systemach kanał danych jest jednokierunkowy (tylko od maszyny do warstwy analitycznej), a wszystkie ścieżki sterowania pozostają w sieci OT pod kontrolą automatyków. Ryzyko cyber ataku rośnie, gdy analityka jest wpinana „po taniości” bez segmentacji i zasad – nie wtedy, gdy projekt prowadzi się wspólnie z działem bezpieczeństwa IT.

Śledzenie zmian w modelach i odpowiedzialność za decyzje

Predykcyjne modele nie są stałe – zmieniają się wraz z procesem i danymi. Każda istotniejsza zmiana modelu (parametrów, wersji, sposobu liczenia cech) powinna pozostawić ślad audytowy: kto zatwierdził, kiedy wdrożono, na jakim zbiorze testowym sprawdzono.

Praktycznym rozwiązaniem jest system wersjonowania modeli, w którym do każdego alarmu można później wrócić i sprawdzić: jaka logika go wygenerowała, jakie sygnały wejściowe miała do dyspozycji AI, jakie były wcześniejsze alarmy tego typu na tej maszynie. Ułatwia to rozmowy po awariach („czy AI mogła to przewidzieć?”) i pozwala unikać pochopnych wniosków o „winie algorytmu”.

Rozwój i skalowanie – od pilota do standardu zakładowego

Udany pilot predykcyjnego utrzymania ruchu ma to do siebie, że szybko pojawia się apetyt na więcej: kolejne linie, nowe fabryki, dodatkowe typy analizy. Tu łatwo wpaść w pułapkę powielania eksperymentów zamiast budowy powtarzalnego standardu.

Szablony wdrożeniowe dla nowych maszyn i zakładów

Najbardziej efektywne organizacje tworzą z pilota gotowe szablony:

- lista minimalnych czujników dla danego typu maszyny (np. sprężarki, pompy, prasy),

- standardowy zestaw cech (features) i modeli, które sprawdziły się w podobnych przypadkach,

- wzorcowy schemat integracji z SCADA/MES/CMMS oraz konfiguracja alarmów.

Zamiast za każdym razem prowadzić długie dyskusje od zera, nowy zakład startuje z pakietem „baseline”, który później dostosowuje do lokalnej specyfiki. To nie tylko przyspiesza roll‑out, ale też ułatwia porównywanie wyników między fabrykami.

Wspólna baza wiedzy o awariach

AI radzi sobie najlepiej tam, gdzie ma dużo przykładów i kontekstu. W przemyśle oznacza to budowę wspólnej bazy wiedzy o awariach, obejmującej:

- opis objawów (z punktu widzenia czujników i operatorów),

- diagnozę przyczyny źródłowej (root cause),

- podjęte działania i ich skuteczność,

- przebiegi sygnałów przed i po interwencji.

Na tej bazie modele mogą uczyć się nie tylko „co jest anomalią”, ale także jak różnią się wzorce prowadzące do konkretnych typów usterek: niewyważenia, rozosiowania, zmęczenia materiału, niedosmarowania. Dobrze działa prosty mechanizm: po każdej większej awarii krótka sesja „post mortem” z udziałem UR, produkcji i – co ważne – osoby odpowiedzialnej za modele AI. Informacje z takiego spotkania wracają później zarówno do CMMS, jak i do zbiorów uczących.

Ekonomia skali – kiedy inwestować w zaawansowane modele

Nie każda maszyna zasługuje na indywidualny model uczenia głębokiego z kilkoma rodzajami czujników. Ekonomicznie sensowne jest skupienie bardziej zaawansowanych analiz na:

- urządzeniach o wysokim koszcie przestoju lub naprawy,

- węzłach krytycznych dla ciągłości całego ciągu technologicznego,

- obszarach, gdzie tradycyjne podejścia (czasokrzywki, inspekcje okresowe) dawały słabe wyniki.

Mit: „skoro mamy platformę AI, to każda maszyna powinna mieć swój model predykcyjny”. W praktyce dużo większy zwrot przynosi dopracowanie kilkunastu naprawdę istotnych obiektów niż „płytkie” monitorowanie wszystkiego. Na pozostałych maszynach wystarczy nieraz proste monitorowanie trendów i reguły progowe – ale na wspólnej infrastrukturze danych, tak aby w razie potrzeby można było podnieść poziom analizy.

Współpraca z dostawcami i integratorami

Predykcyjne utrzymanie ruchu wciąga do stołu wielu graczy: producentów maszyn, dostawców czujników, integratorów automatyki, firmy od AI i platform IoT. Żeby nie skończyć z zestawem niespójnych „wysp”, potrzebne są jasne zasady współpracy.

Otwarte interfejsy i unikanie „złotych klatek”

Naturalną pokusą wielu dostawców jest zamknięcie klienta w swoim ekosystemie – własne czujniki, własne protokoły, własny serwer analityczny. Dla zakładu to krótkoterminowa wygoda, ale długoterminowo duże ograniczenie.

Przy wyborze rozwiązań sensownie jest wymagać:

- otwartych i udokumentowanych API do odczytu danych (najlepiej po standardach przemysłowych),

- możliwości eksportu surowych i przetworzonych sygnałów do centralnej platformy zakładowej,

- braku sztucznych ograniczeń licencyjnych na dostęp do własnych danych procesowych.

Jeżeli dostawca predykcji dla konkretnego typu urządzenia (np. sprężarek) nie pozwala na wyprowadzenie danych ani wyników poza swoją chmurę, trzeba założyć, że buduje się osobną wyspę, która nigdy w pełni nie zgra się z resztą ekosystemu UR.

Kontrakty serwisowe oparte na danych

AI i IoT otwierają drogę do bardziej partnerskich modeli współpracy z dostawcami maszyn i serwisów. Zamiast tradycyjnego „przegląd raz w roku”, możliwe staje się:

- ustalenie warunków serwisu zależnych od stanu (np. wymiana łożysk po przekroczeniu konkretnego wskaźnika zmęczeniowego),

- zdalne konsultacje na podstawie bieżących sygnałów i historii, zanim serwisant przyjedzie na miejsce,

- wspólne projekty poprawy niezawodności, gdzie dane z wielu zakładów zasilają ulepszenia konstrukcyjne kolejnych generacji maszyn.

Pod jednym warunkiem: dane muszą być uporządkowane, opisane i dostępne w powtarzalny sposób. Jeśli każdy zakład przesyła dostawcy inne zestawy plików w innym formacie i z innymi nazwami sygnałów, nawet najlepszy serwis będzie działał reaktywnie, a nie predykcyjnie.

Rola ludzi – jak zbudować zespół do predykcyjnego utrzymania ruchu

Najlepsze algorytmy niewiele zrobią, jeśli w zakładzie nie ma ludzi, którzy potrafią z nich korzystać i im zaufać. Predykcyjne utrzymanie ruchu nie eliminuje roli mechaników, automatyków i operatorów – zmienia tylko proporcje między gaszeniem pożarów a pracą analityczną.

Skład kompetencyjny – kto jest naprawdę potrzebny

W praktycznych wdrożeniach przewijają się cztery kluczowe role. Czasem to różne osoby, czasem jedna łączy kilka kapeluszy:

- Inżynier UR / reliability engineer – zna maszyny, katalogi usterek, tryby uszkodzeń. Pomaga przełożyć „anomalię na łożysku” na konkretny plan działania.

- Automatyk / inżynier OT – rozumie sterowniki, sieci przemysłowe, SCADA. Bez niego integracja czujników i danych szybko staje w miejscu.

- Data scientist / inżynier AI – odpowiada za dobór modeli, walidację, interpretację wyników; nie musi znać każdego zaworu, ale powinien rozumieć, co w fizyce procesu jest realne, a co nie.

- „Tłumacz biznesowo‑techniczny” – często kierownik UR lub inżynier produkcji, który spina całość: priorytety biznesowe, budżet, zakres pilota i KPI.

Mit, który często się pojawia: „kupimy platformę AI i ona sama się wszystkim zajmie”. W rzeczywistości bez ludzi, którzy wiedzą, jak maszyny się psują, jakie awarie są krytyczne, a które można świadomie zaakceptować, platforma będzie generować ładne wykresy, ale nie przełoży się na mniej przestojów.

Szkolenia operatorów i UR – jak zbudować zaufanie do alarmów AI

Jeżeli operatorzy i służby UR traktują alarmy predykcyjne jak „kolejny hałas z ekranu”, projekt szybko traci sens. Dlatego podstawą jest proste, operacyjne przeszkolenie:

- jak wygląda typowy alarm (co oznacza, gdzie go widać, jakie są statusy),

- jakie są oczekiwane reakcje przy różnych poziomach ważności (od „obserwuj” po „wyłącz maszynę w ciągu X minut/godzin”),

- jak przekazywać informację zwrotną: kiedy zgłoszenie sprawdziło się, a kiedy okazało się fałszywe lub mało przydatne.

Dobrze działa prosty mechanizm: przy pierwszych alarmach analityk AI lub inżynier projektu fizycznie pojawia się na zmianie, idzie z brygadzistą pod maszynę, wspólnie oglądają sygnały i stan rzeczywisty. Po kilku takich sesjach ludzie zaczynają kojarzyć: „ten typ alarmu faktycznie poprzedzał problemy z łożyskiem”, a zaufanie rośnie znacznie szybciej niż od samych prezentacji na sali konferencyjnej.

Zmiana nawyków – z naprawy po awarii do diagnozy z wyprzedzeniem

Predykcja przesuwa środek ciężkości pracy UR:

- mniej akcji „wszyscy na linię, bo stanęło”,

- więcej zaplanowanych interwencji podczas okien produkcyjnych,

- systematyczna analiza powracających przyczyn usterek.

Rzeczywistość jest taka, że część zespołu odczuwa to jako zagrożenie („skoro nie będzie awarii, to czy będziemy potrzebni?”). Odpowiedź powinna być jasna: zadania się zmieniają, ale pracy nie ubywa – po prostu przesuwa się ona w kierunku prewencji, usprawnień i współpracy z produkcją, zamiast akcji ratunkowych w nocy.

Projektowanie procesów utrzymania ruchu „pod AI”

Sama analityka nie wystarczy – potrzeba procedur, które włączają predykcję w codzienną pracę UR. Bez tego system zamienia się w tablicę ogłoszeń, na którą nikt nie zagląda.

Standardowe ścieżki obsługi alarmów

Dla każdego typu alarmu predykcyjnego przydaje się krótka „instrukcja pierwszych kroków”. Nie chodzi o rozbudowane podręczniki, tylko prosty, jedno‑ lub dwustronicowy opis:

- co oznacza dany wskaźnik (np. wzrost RMS drgań w konkretnym paśmie),

- jakie są typowe przyczyny (rozosiowanie, poluzowane posadowienie, niewyważenie),

- jakie czynności kontrolne wykonać na miejscu (oględziny, pomiar ręcznym przyrządem, sprawdzenie temperatury, dźwięku, wycieków),

- kiedy eskalować (np. gdy trend rośnie przez X godzin/dni z rzędu).

Mit: „AI powie dokładnie, co wymienić i kiedy”. Realne podejście: AI wskazuje obszar ryzyka i jego dynamikę, a człowiek decyduje, czy już działać, czy jeszcze obserwować. Bez ustandaryzowanych ścieżek każdy będzie interpretował alarmy po swojemu, co kończy się chaosem i utratą wiarygodności systemu.

Powiązanie predykcji z planowaniem produkcji i magazynem części

Predykcyjne utrzymanie ruchu ma największą wartość, gdy wpływa na harmonogramy produkcyjne i gospodarkę częściami zamiennymi. Kilka praktycznych zasad:

- alarmy o wysokiej ważności automatycznie trafiają jako sugestie zadań do CMMS – z przewidywanym horyzontem czasu,

- planista produkcji widzi „okno ryzyka” dla kluczowych maszyn i może przesuwać zlecenia tak, aby w razie potrzeby wykonać przestój kontrolowany,

- dla krytycznych komponentów (np. dużych łożysk, przekładni) utrzymuje się minimalny zapas, a predykcja pomaga optymalizować zamówienia tak, by unikać i braków, i nadmiernego zamrożenia kapitału.

Przykład z praktyki: na jednej z linii pakujących analiza drgań pokazała rosnące ryzyko uszkodzenia napędu przenośnika. Zamiast czekać, aż napęd zatrzyma linię w środku tygodnia, zespół przesunął plan produkcji i wykonał wymianę podczas planowanego postoju weekendowego. Przestój nie zwiększył się ani o godzinę, a uniknięto nagłej awarii w szczycie.

Jak mierzyć efekty wdrożenia predykcyjnego utrzymania ruchu

Bez mierników łatwo wpaść w skrajności: albo w zachwyt nad każdym wykresem, albo w rozczarowanie „bo nie widać różnicy”. Potrzebny jest ograniczony, ale konsekwentnie stosowany zestaw KPI.

KPI techniczne i biznesowe – dwa spojrzenia na ten sam system

Zwykle stosuje się dwa poziomy wskaźników:

- Techniczne: liczba awarii nieplanowych, liczba zatrzymań z powodu usterek, średni czas między awariami (MTBF), średni czas naprawy (MTTR), liczba wykrytych usterek w fazie wczesnej.

- Biznesowe: utracona produkcja z tytułu przestojów, koszty napraw (części + robocizna), koszty ekspresowych dostaw części, liczba godzin pracy w trybie „akcja awaryjna” vs. „prace planowe”.

Częsty mit: „efekty predykcji widać od razu w OEE”. Rzeczywistość: przez pierwsze miesiące OEE może się prawie nie zmienić, bo równolegle zachodzą inne zmiany w produkcji. Natomiast bardzo szybko widać różnicę w strukturze przestojów i w tym, ile z nich jest w trybie kontrolowanym, a ile „na syrenie”.

Ocena jakości modeli – od fałszywych alarmów do „przegapionych” usterek

Oprócz klasycznych KPI UR potrzebna jest ocena skuteczności samych modeli. W praktyce sprowadza się to do trzech pytań:

- jak często model generuje fałszywe alarmy, które nie prowadzą do realnej usterki,

- ile rzeczywistych awarii wystąpiło bez wcześniejszego sygnału z systemu,

- jak wcześnie (ile godzin/dni) przed zdarzeniem pojawiał się pierwszy wiarygodny sygnał.

Naturalna pokusa to „wycięcie” fałszywych alarmów poprzez podniesienie progów tak wysoko, że system milknie. Tymczasem sensowniejsze jest wspólne przeanalizowanie kilku przypadków: co model „widział”, jak zachowywały się inne sygnały, czy zespół UR miał szansę wynieść z tego jakąś lekcję. Część pozornie fałszywych alarmów okazuje się czułym wczesnym ostrzeżeniem przed problemem, którego jeszcze nie klasyfikujemy jako awarię.

Ewolucja modeli – od prostych reguł do uczenia federacyjnego

Systemy predykcyjne rzadko pozostają w formie z dnia pilotażu. Wraz z rosnącą bazą danych i doświadczeń dojrzewają również stosowane podejścia modelowe.

Kiedy prosta analityka wystarcza, a kiedy sięgać po głębokie sieci

Na początek zwykle wystarczy połączenie:

- filtracji sygnałów (wygładzenie, usuwanie szumów i wartości odstających),

- statystycznych wskaźników (średnie, odchylenia, trendy, korelacje),

- prostszych metod wykrywania anomalii (np. modele jednowymiarowe per czujnik lub PCA/autoenkodery dla grup sygnałów).

Dopiero gdy te narzędzia dochodzą do ściany – np. wiele nakładających się stanów maszyny, szybko zmieniające się receptury, silna nieliniowość – sens ma sięgnięcie po bardziej złożone architektury: sieci rekurencyjne, transformery czasowe czy modele hybrydowe łączące wiedzę fizyczną z danymi (tzw. physics‑informed ML).

Mit: „prawdziwa AI to zawsze deep learning”. W środowisku przemysłowym więcej wartości często wnosi dobrze skalibrowany model prostszy, który łatwo wyjaśnić mechanikowi, niż czarna skrzynka o minimalnie lepszych statystykach.

Modele współdzielone między zakładami i uczenie federacyjne

W większych organizacjach pojawia się naturalne pytanie: jak wykorzystać doświadczenia z jednego zakładu w innych lokalizacjach, nie kopiując wszystkiego ręcznie i nie mieszając wrażliwych danych?

Dobrym uzupełnieniem będzie też materiał: AI na krawędzi sieci: edge computing w przemyśle i czasie rzeczywistym — warto go przejrzeć w kontekście powyższych wskazówek.

Jedno z podejść to modele bazowe trenowane na agregatach danych z różnych fabryk, a następnie dostrajane lokalnie do konkretnej linii czy maszyny. Dzięki temu:

- nowa instalacja nie startuje „od zera”, tylko od razu dysponuje sensownymi progami i wzorcami anomalii,

- rzadkie typy usterek (które w jednym zakładzie zdarzają się raz na kilka lat) mogą być lepiej rozpoznawane dzięki danym z całej grupy.

Krok dalej to uczenie federacyjne, gdzie modele uczą się na danych pozostających fizycznie w zakładach, a do centralnej instancji trafiają jedynie zaktualizowane parametry modeli. Taki mechanizm ogranicza przepływ wrażliwych danych surowych, jednocześnie pozwalając wykorzystać efekt skali.

Specyfika branż – różne procesy, różne podejścia do AI i IoT

Choć zasady ogólne są podobne, predykcyjne utrzymanie ruchu wygląda inaczej w hucie stali, inaczej w farmacji, a jeszcze inaczej w logistyce wewnętrznej. Różni się tempo zmian, akceptowalny poziom ryzyka i możliwości zbierania danych.

Procesy ciągłe vs. dyskretne

W procesach ciągłych (chemia, petrochemia, produkcja energii):

- maszyny często pracują w trybie 24/7,

- przestoje bywają skrajnie kosztowne,

- dane procesowe są z natury „ciągłe” i dobrze próbkowane (SCADA, DCS).

Tutaj AI świetnie sprawdza się przy długoterminowym monitorowaniu trendów, wykorzystując stabilność procesu do „nauczenia się”, co jest normalne.

W produkcji dyskretnej (montaż, pakowanie, obróbka):

- częściej występują zmiany asortymentu, krótkie serie, przezbrojenia,

- maszyny mają wiele trybów pracy i stanów przejściowych,

- duża część danych dotyczy nie tylko stanu technicznego, ale też samego przepływu sztuk (ilości, błędy jakościowe, odrzuty).

Modele muszą więc rozróżniać kontekst: inny wzorzec drgań przy prędkości 20%, inny przy 100%, inny w czasie rozruchu. Stąd większy nacisk na poprawne etykietowanie stanów pracy i konfigurowalność modeli per tryb.

Środowiska regulowane – farmacja, spożywka, automotive

W branżach mocno regulowanych każdy dodatkowy element systemu (czujnik, algorytm, interfejs) może podlegać audytom i walidacji. To nie wyklucza predykcji, ale wymusza inne tempo zmian.

- Modele muszą być wersjonowane i opisywane językiem zrozumiałym dla audytora (co liczą, jakie sygnały biorą pod uwagę, jak były testowane).

- Automatyczne decyzje typu „zatrzymaj linię” wymagają dodatkowych kontroli – częściej stosuje się sygnały doradcze (advisory), a ostateczna decyzja pozostaje po stronie człowieka.

- Zapis historii jest szczególnie istotny: dla każdej ingerencji w proces (np. wcześniejsza wymiana komponentu) trzeba mieć możliwość odtworzenia motywacji i podstaw danych.

Mit: „regulacje uniemożliwiają stosowanie AI”. W praktyce to raczej kwestia dobrej dokumentacji, przejrzystości i zachowania ścieżki odpowiedzialności niż przeszkoda nie do przejścia.

Przygotowanie organizacji na dalszą automatyzację decyzji

Dzisiejsze systemy predykcyjne w większości pełnią rolę doradczą. Wraz z dojrzewaniem danych i modeli naturalne staje się przesuwanie granicy automatyzacji coraz bliżej realnego sterowania.

Od rekomendacji do samodzielnych działań systemu

Pierwszy etap to zwykle tryb „asystenta”: system wystawia rekomendacje z określonym priorytetem, a zespół UR sam decyduje o działaniach. Ten okres kalibracji jest kluczowy – ludzie uczą się ufać algorytmom, a algorytmy są korygowane na bazie realnych decyzji. Warto wtedy pilnować prostej dyscypliny: każda zignorowana rekomendacja powinna mieć krótkie uzasadnienie, a każda zrealizowana – odnotowany efekt. Bez tego szybko zamieni się to w „kolejny system, który coś tam pokazuje w tle”.

Dopiero po takim przetarciu szlaków można świadomie przekazywać część decyzji w pełni automatycznie. Dobrze działa tu podejście stopniowe: najpierw automatyzuje się decyzje niskiego ryzyka (np. automatyczne zgłoszenie zlecenia w CMMS, obniżenie prędkości linii w reakcji na przegrzewanie), a dopiero później decyzje o zatrzymaniu całej instalacji. Kluczowe jest też zdefiniowanie „strefy manualnej” – sytuacji, w których automat może tylko sygnalizować problem, ale nie ma prawa ingerować w proces.

Mit, który często blokuje rozwój: „albo pełna automatyzacja, albo wszystko ręcznie”. W praktyce najlepsze efekty daje właśnie szara strefa pomiędzy – system robi to, co powtarzalne i dobrze opisane, a ludzie skupiają się na sytuacjach niestandardowych. Tam, gdzie proces jest dobrze ustrukturyzowany i ryzyko skwantyfikowane (np. logistyka wewnętrzna), udział decyzji automatycznych może być wysoki. W obszarach silnie regulowanych lub o dużym koszcie błędu (np. media krytyczne, bezpieczeństwo procesowe) rola człowieka długo pozostanie centralna.

Ostatni element to jasne zasady odpowiedzialności i „prawa weta”. Operator powinien zawsze mieć możliwość nadpisania decyzji systemu, ale taka interwencja nie może znikać bez śladu. Krótki komentarz, przyczyna, ewentualne załączone zdjęcie lub wideo – to paliwo do dalszego doskonalenia modeli. Bez tego szybko pojawi się kolejny mit: „system się myli, więc go wyłączamy”, zamiast konstruktywnej informacji zwrotnej, czego dokładnie zabrakło, by decyzja automatu była akceptowalna.

Predykcyjne utrzymanie ruchu oparte na AI i IoT nie jest magicznym pudełkiem, które „załatwia awarie”, tylko długoterminowym projektem łączącym dane, technologię i zmianę sposobu pracy. Tam, gdzie udaje się je mądrze wpleść w istniejące procesy i kulturę, przestaje być „projektem AI”, a staje się po prostu nowym standardem zarządzania majątkiem produkcyjnym – mniej reaktywnym, bardziej świadomym i lepiej udokumentowanym.

Najczęściej zadawane pytania (FAQ)

Na czym polega predykcyjne utrzymanie ruchu i czym różni się od prewencyjnego?

Predykcyjne utrzymanie ruchu opiera się na bieżącej analizie rzeczywistego stanu maszyn, a nie na „sztywnym” harmonogramie przeglądów. Zamiast wymieniać części co 6 miesięcy „bo tak w planie”, system analizuje dane z czujników (drgania, temperatura, prąd, ciśnienie) i wskazuje, kiedy ryzyko awarii realnie rośnie.

Prewencja działa na kalendarz lub liczbę godzin, co często prowadzi do przewymiany części. Predykcja reaguje na symptomy w danych – pozwala zaplanować postój zanim dojdzie do uszkodzenia, ale bez wyrzucania sprawnych elementów do kosza. Mit jest taki, że predykcja to „magia AI”, która wszystko załatwi. W praktyce to dobrze zorganizowany proces oparty na pomiarach i konkretnych procedurach reakcji.

Jaką rolę odgrywają sztuczna inteligencja i IoT w predykcyjnym utrzymaniu ruchu?

IoT odpowiada za zbieranie i przesyłanie danych z maszyn: czujniki drgań, temperatury, prądu, ciśnienia czy akustyczne wysyłają sygnały przez sieć przemysłową do systemów analitycznych. Sterowniki PLC, systemy DCS i SCADA często już dziś mają większość tych informacji – trzeba je tylko „wyciągnąć” z szafy sterowniczej do warstwy analizy.

Sztuczna inteligencja analizuje zebrane dane, wykrywa wzorce i anomalie, które zapowiadają awarię. Może np. wychwycić subtelną zmianę widma drgań łożyska czy niestandardowy profil poboru prądu silnika. Rzeczywistość jest taka, że AI nie zastępuje mechaników – raczej wzmacnia ich „ucho” i doświadczenie, podając konkretne alerty zamiast ogólnego przeczucia.

Jakie realne korzyści biznesowe daje predykcyjne utrzymanie ruchu?

Najbardziej namacalny efekt to ograniczenie nieplanowanych przestojów. Każda godzina postoju kluczowej linii ma konkretną cenę, a predykcja pozwala przenieść wiele awarii z kategorii „nagły postój” do „zaplanowany downtime”. Dzięki temu planista produkcji może lepiej ułożyć zlecenia, a logistyka – dostawy surowców i wysyłki.

Druga grupa korzyści dotyczy kosztów i bezpieczeństwa: części wymieniane „kiedy faktycznie trzeba”, a nie „na wszelki wypadek”, pracują dłużej i nie zamrażają niepotrzebnie kapitału w magazynie. Wczesne wykrycie anomalii w parametrach ciśnienia, temperatury czy drgań zmniejsza też ryzyko wycieków, pożarów czy awarii zagrażających zdrowiu ludzi i środowisku.

Czy predykcyjne utrzymanie ruchu opłaca się tylko dużym koncernom?

To jeden z bardziej szkodliwych mitów. Predykcyjne utrzymanie ruchu nie jest zarezerwowane wyłącznie dla globalnych koncernów z gigantycznymi budżetami. Małe i średnie zakłady często zaczynają od jednej linii lub kilku najbardziej krytycznych maszyn, wykorzystując istniejące sterowniki PLC i czujniki, a tylko punktowo dodając nowe pomiary.

Rozsądny pilotaż można przeprowadzić relatywnie tanio, jeśli najpierw określi się, co naprawdę „boli”: np. konkretna pompa, która co kilka miesięcy zatrzymuje całą instalację. Zamiast robić rewolucję w całym zakładzie, lepiej udowodnić efekt na małej skali, a potem skalować. Rzeczywistość pokazuje, że właśnie takie projekty „małymi krokami” mają największą akceptację załogi.

Jakie czujniki są potrzebne do predykcyjnego utrzymania ruchu?

Najczęściej wykorzystywane są czujniki drgań (łożyska, przekładnie, pompy, wentylatory), temperatury (silniki, łożyska, szafy sterownicze), oraz prądu i mocy (silniki, napędy). W wielu procesach krytyczne są również czujniki ciśnienia i przepływu (hydraulika, pneumatyka, układy z płynami) oraz czujniki akustyczne/ultradźwiękowe do wykrywania nieszczelności czy wycieków sprężonego powietrza.

Mit brzmi: „im więcej czujników, tym lepsza predykcja”. W praktyce liczy się nie ilość, a sensowny dobór punktów pomiarowych pod konkretne tryby uszkodzeń. Dobre projekty powstają przy wspólnej pracy inżyniera UR, technologa i specjalisty od danych, którzy pytają wprost: jakie awarie tej maszyny naprawdę nas bolą i jak objawią się w danych?

Jak uniknąć sytuacji, w której projekt AI/IoT kończy się tylko „gadżetem na ścianie”?

Kluczowe jest wpięcie systemu predykcyjnego w istniejący proces utrzymania ruchu, a nie traktowanie go jako osobną „zabawkę z wykresami”. Dla każdego typu alarmu musi być jasne, kto reaguje, w jakim czasie i co dokładnie robi – najlepiej w formie konkretnych procedur UR. System powinien być powiązany z CMMS, aby z alertów automatycznie powstawały zlecenia prac.

Drugą rzeczą jest mierzenie efektu: wskaźniki typu MTBF, MTTR, OEE przed i po wdrożeniu, liczba nieplanowanych postojów, zużycie części. Bez tego projekt łatwo sprowadzić do „ładnego dashboardu”. Rzeczywistość jest taka, że technologia sama w sobie nie przynosi oszczędności – dopiero zmiana sposobu pracy i decyzji robi różnicę.

Jak zacząć wdrażanie predykcyjnego utrzymania ruchu w istniejącym zakładzie?

Dobrym punktem startu jest wybór jednej linii lub kilku maszyn, które generują największe koszty przestojów lub najwięcej nerwowych interwencji. Następnie trzeba sprawdzić, jakie dane już są dostępne w PLC, DCS, SCADA i co można odczytać przez Modbus, OPC UA czy inne protokoły – często pierwsze modele można zbudować bez rozbudowanej instalacji nowych czujników.

Kolejny krok to prosta, ale konkretna architektura: czujniki i sterowniki → bramka komunikacyjna (edge) → system analityczny/AI → CMMS. Równolegle trzeba przeszkolić operatorów i służby UR, pokazać im pierwsze alerty i wspólnie dostroić progi alarmowe. Zaczynając od pilotażu, łatwiej obalić mit, że „to u nas się nie sprawdzi”, bo pojawiają się pierwsze uniknięte przestoje, a z nimi realne liczby.